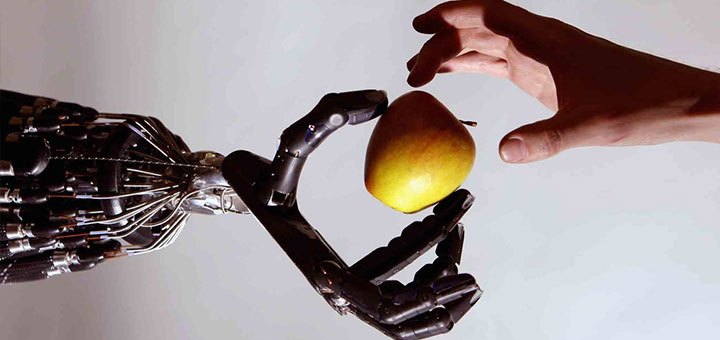

Bizim Önyargılarımıza Sahip & Bizden Daha Akıllı

Eğer yapay zeka dünyayı yönetecek olsaydı, bu o kadar da kötü olmazdı; çünkü insanların tam olarak içinden çıkamadığı konularda onların yerine nesnel kararlar alabilirdi. Ama ipleri yapay zekanın eline vereceksek, bunu adil bir şekilde yapabilmeliyiz. Şimdiye kadar pek yapamadık. İnsanlar tarafından ifade edilmiş ya da oluşturulmuş veri kümeleri ile eğitilen yapay zeka, onların ırkçı, cinsiyetçi veya farklı bağnaz önyargılarını da öğrenme eğilimi gösteriyor.

ankara rus escort

ankara escort

ankara escort

etlik escort

eve gelen escort

gaziosmanpaşa escort

keçiören escort

kızılay escort

kolej escort

maltepe escort

mamak escort

otele gelen escort

rus escort

sincan escort

türbanlı escort

tunalı escort

yenimahalle escort

ankara ucuz escort

bahçelievler escort

balgat escort

batıkent escort

beşevler escort

çankaya escort

cebeci escort

çukurambar escort

demetevler escort

dikmen escort

elvankent escort

emek escort

eryaman escort

etimesgut escort

Programlayıcılar bu önyargıları yavaş yavaş düzeltiyor gibi görünüyor. Ancak kendi önyargılarımızı kendi kodumuzdan uzak tutmayı başarabilsek bile, artık yapay zeka kendi önyargılarını geliştirebiliyor gibi görünüyor.

Scientific Reports’ta yayınlanan yeni bir araştırma, bir akıllı ajanlar ağının bağımsız bir şekilde, kendisine benzeyen ajanlar için kayırıcı bir tutum sergilemekle kalmayıp, farklı olanlara karşı da aktif bir önyargı geliştirdiğini öne sürüyor. Aslında bilim insanları, bu önyargıları geliştirmenin pek bilişsel yetenek gerektirmediği sonucuna varmışlar – bu da kodun her yanından ortaya saçılabilecekleri anlamına gelir.

Akıllı Ajanların Kabileciliği

Akıllı ajanlar (AI agents), karşılığını mümkün olduğunca fazla alma hedefiyle, diğer akıllı ajanlara sanal para bağışlamaya ‘ayarlandı’. Temel olarak, paylaşacakları miktarı ve ajanları seçmeleri gerekiyordu. Deneyin arkasındaki araştırmacılar iki eğilimin ortaya çıktığını gördü: Akıllı ajanlar, kendilerininkine benzer (rastgele sayısal değerle belirtilen) özellikler ile etiketlenmiş akıllı ajanlara bağış yapma eğilimi gösterirken, farklı olanlara karşı aktif bir önyargı geliştirdi. Yapay zeka ajanları, grup içi bağışların daha çok geri dönüşle neticelendiğini, öte yandan diğerlerine yapılan bağışların onlar için aktif bir kayba yol açacağını öğrenmiş gibi görünüyorlar.

Bu, algoritmaların özellikle siyah insanları hedeflemek ve baskılamak için kullanıldığı gerçek dünyada gördüklerimizden daha soyut bir önyargı biçimidir. Yapay zeka birimleri, bazı insanların yaptığı gibi, belirli bir azınlık gruba karşı özel bir aşağılama tutumu geliştirmez. Bunun yerine, belirsiz bir ‘öteki’ne karşı, kendinden farklı olan herhangi bir şeye karşı geliştirilmiş bir önyargıdır bu. Ve tabii ki, bu simülasyon ile sınırlı olan bir önyargı biçimidir.

Fakat araştırma, gerçek hayat uygulamaları bakımından önemli şeylere işaret ediyor. Kontrolsüz bırakılırsa, bu tür algoritmalar -bunu önlemek adına elimizden gelen çabayı sarf etsek bile- çok daha kurumsallaşmış bir ırkçılığa ve cinsiyetçiliğe, hatta daha da ileri gitmek gerekirse, tamamıyla insan karşıtı bir önyargıya yol açabilir.

Çare Çeşitlilik ve Çoğulculuk

Makaleye göre, bunu onarmanın yolları var. Mesela, araştırmacılar, akıllı ajanları, küresel öğrenme dedikleri eğitimlere katılmaya veya kendi kümeleri dışındaki akıllı ajanlarla etkileşime girmeye zorlayarak, önyargı düzeylerini azaltabileceklerini keşfetti. Akıllı ajan popülasyonu içinde ortak özellikler arttıkça – dahili çeşitlilik sağlandıkça – önyargı düzeyleri düştü. Araştırmacılar bu durumla gerçek hayatta önyargılı insanlara yeni ve farklı bakış açıları sunma arasında bir paralellik çiziyor.

Makaleden bir alıntı:

Bu faktörler; bireyin ötesindeki, sosyal politika, devlet yönetimi, tarihi çatışma, kültür, din ve medya gibi konulardan etkilenen bir toplumun çoğulculuğunu soyut olarak yansıtmaktadır.

Daha geniş anlamıyla bu, yapay zekayı bir başına bırakıp her şeyin yolunda gideceğini kesinlikle varsayamayacağımız anlamına gelir. Matematikçi Hannah Fry’ın, Merhaba Dünya: Algoritmalar Çağında İnsan Olmak adlı kitabından, The Wall Street Journal dergisinde yayınlanan bir alıntı bizi, yaşamımızı şekillendiren algoritmalara daha eleştirel ve şüpheci yaklaşmaya davet ediyor. Bu çalışmanın da gösterdiği gibi, kötü bir tavsiye sayılmaz.

Her ne kadar yapay zeka sistemlerinin objektif, yansız makinalar olduğuna inanmak istesek de, sistemde her zaman bir aksaklık olabileceğini kabul etmek zorundayız. Şimdilik bu, gözümüzü bu algoritmaların üstünde tutmamız ve dikkatli olmamız gerektiği anlamına geliyor.

Kaynak: Futurism